全源导航技术、协同导航技术、视觉惯性SLAM、智能信息融合技术、目标检测与识别

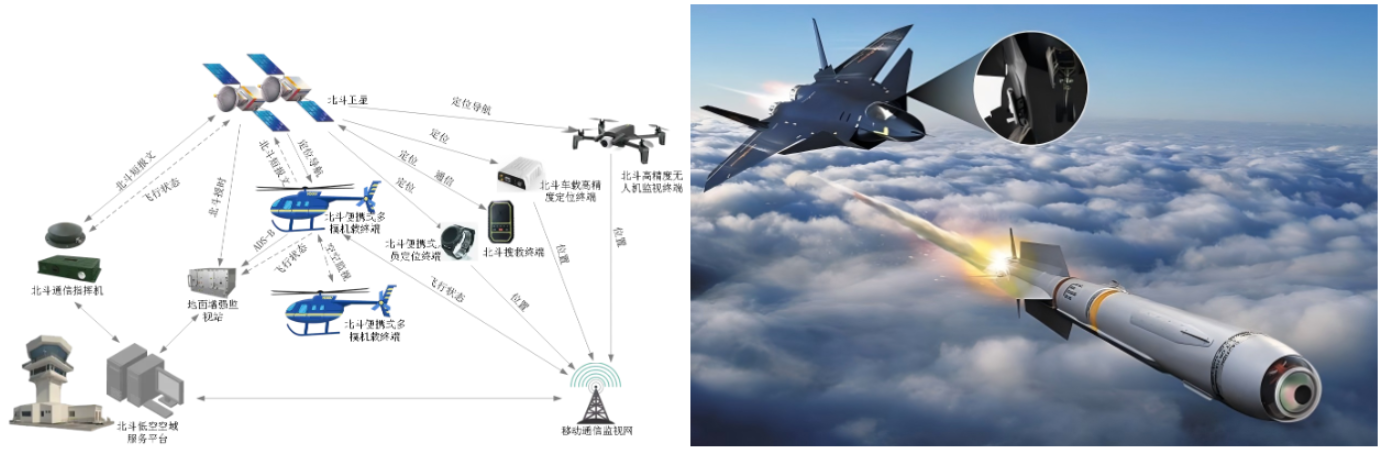

全源导航技术

全源导航的核心意义在于通过一种高度智能和自适应的方法,融合所有可用的导航信息源(如惯性导航、卫星导航、视觉、天文、地磁、甚至广播信号等),旨在为无人机、无人车、单兵系统以及在GPS信号被干扰、遮挡的拒止环境(如室内、水下、城市峡谷或强对抗战场)下的作战平台,提供连续、可靠且高精度的定位、导航与授时(PNT)服务,实现传感器的“即插即用”和算法的动态重构,从而显著提升导航系统的容错性、环境适应性及任务韧性,有效解决了传统单一或固定组合导航系统在复杂场景下的局限性。

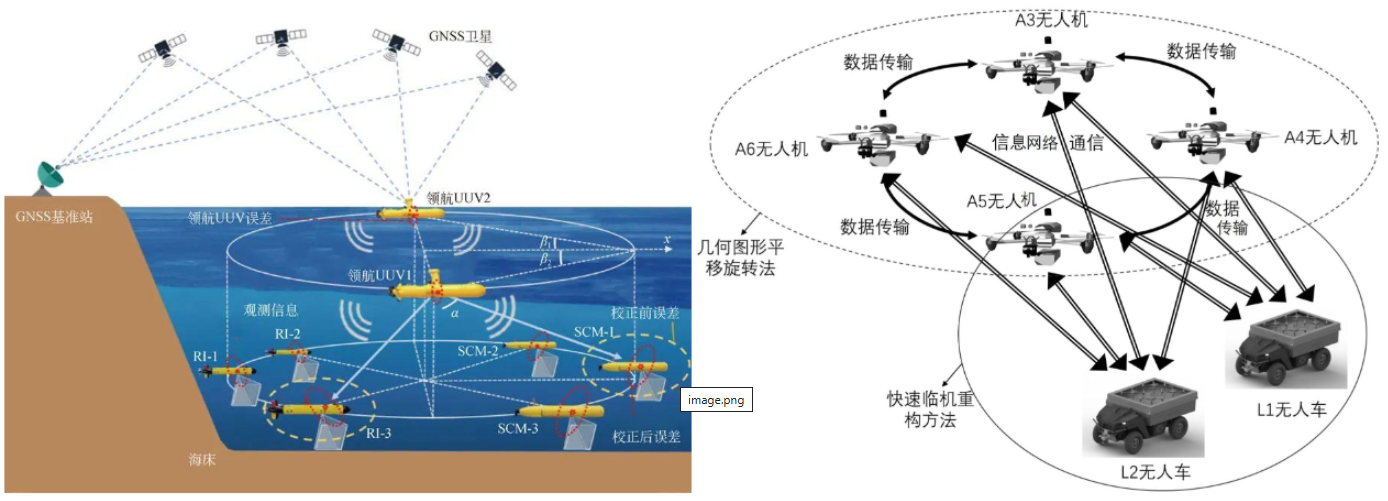

协同导航技术

协同导航技术是一种通过多个运动平台(如无人机、机器人、车辆等)之间的信息交互与共享,来提升整个系统导航性能的技术。编队中的平台通过水声设备、数据链、UWB(超宽带)等通信手段共享各自的位置、速度等导航信息,并利用相对测量传感器(如雷达、视觉传感器)感知彼此间的相对位姿。进而采用滤波算法或优化算法对信息进行融合处理,使得高精度导航能力能够从个别装备优良的平台“传递”至其他仅配备低精度传感器的平台,从而显著提升编队在复杂或GPS拒止环境下的整体定位精度、鲁棒性和任务可靠性。该技术是实现无人机集群协同作战、多机器人协作等应用的关键基础。

视觉惯性SLAM

视觉惯性SLAM是无人平台(无人机、无人车等)在未知环境中实时估计自身运动并构建环境地图的技术。通过联合处理相机捕获的连续图像序列(视觉信息)和惯性测量单元(IMU)提供的加速度与角速度(惯性信息)来工作。视觉信息可用于估计姿态和识别环境特征点,但容易受光照、纹理影响;惯性信息则能提供高频的运动预测,弥补视觉在快速运动或图像模糊时的不足。通过紧耦合的非线性优化算法将两者深度融合,视觉惯性SLAM能有效克服单一传感器的局限性,在多数场景下实现比纯视觉或纯惯性导航更高精度和更强鲁棒性的位姿估计与地图构建,是解决GPS等信号缺失环境下自主导航问题的重要方案。

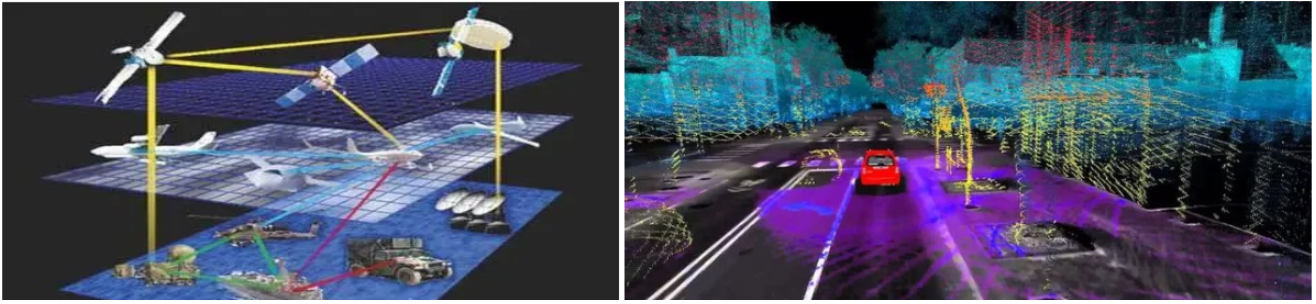

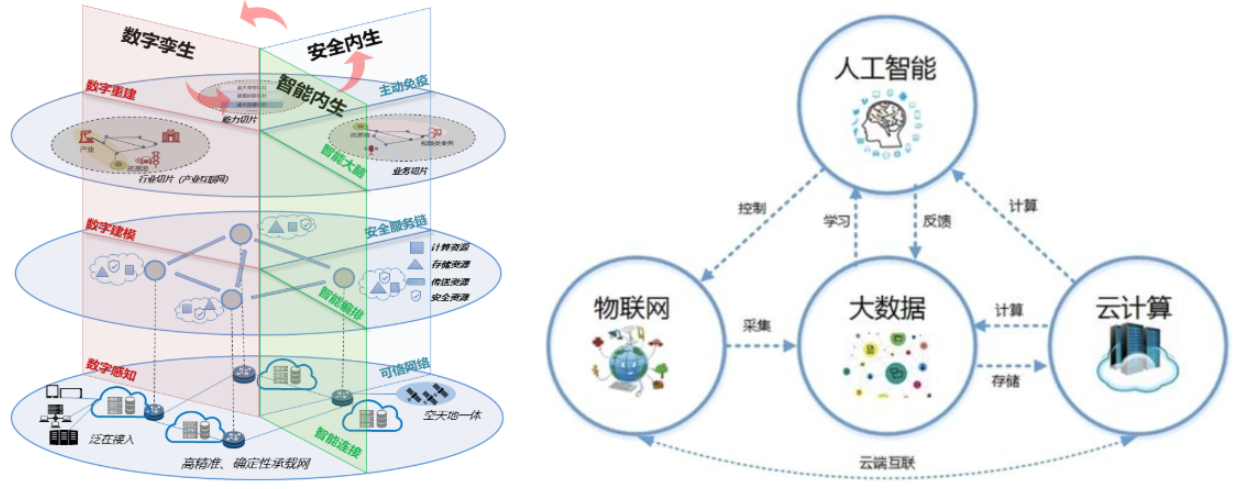

智能信息融合技术

智能信息融合技术旨在将来自多个来源(如不同传感器、数据库、先验知识)的数据和信息进行智能化关联、故障诊断与组合,以形成比单一信息源更完整、准确、可靠的态势判断,涉及从低层的数据级融合到高层的决策级融合。该技术不仅运用传统的状态估计方法(如卡尔曼滤波系列),还 increasingly 引入机器学习、深度学习等人工智能方法,以自适应地处理不确定性、识别复杂模式并进行预测。通过智能融合,系统能够充分利用多源信息的互补性,显著提升环境感知、目标识别、态势评估及决策制定的准确性和智能化水平,在自动驾驶、工业机器人和军事监控等领域有广泛应用。

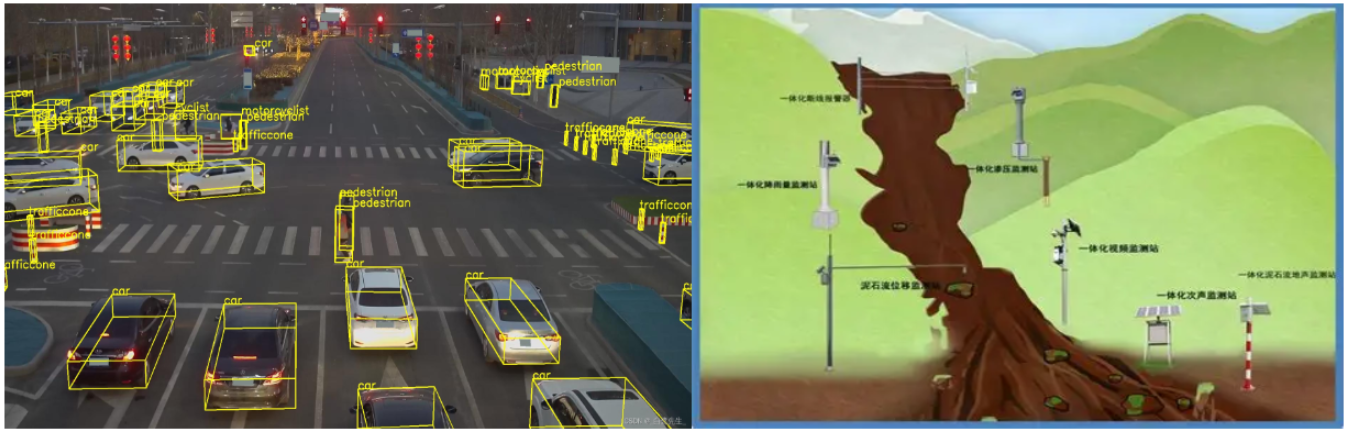

目标检测与识别

目标检测与识别是计算机视觉的核心任务,旨在让机器能够自动识别图像或视频序列中的特定物体,并确定其类别和位置。通过传感器(如相机、激光雷达)获取环境数据,进而利用算法从数据中提取特征以判断是否存在感兴趣的目标(如车辆、行人、障碍物)。传统方法可能依赖手工设计的特征,而当前的主流方法是基于深度学习(特别是卷积神经网络)的模型,它们能端到端地学习并实现极高的准确率。在协同导航系统中,这项技术使移动平台能够感知周围的其他平台、动态障碍物或特定地标,为相对定位、避障避碰、路径规划等提供关键的环境感知信息,是实现智能交互与自主决策的重要基础。

Research direction

究方向

Contact information

系方式移动电话:

邮箱:

东北林业大学版权所有 中国 黑龙江哈尔滨市香坊区和兴路26号 邮编 150040 黑ICP备19004777号